Seorang hakim di negara bagian Washington telah memblokir bukti video yang telah “ditingkatkan dengan AI” untuk diajukan dalam persidangan tiga pembunuhan. Dan itu adalah hal yang baik, mengingat fakta bahwa terlalu banyak orang yang berpikir untuk menerapkan penyaring AI dapat memberi mereka akses ke data visual rahasia.

Hakim Leroy McCullough di King County, Washington menulis dalam keputusan barunya bahwa teknologi AI menggunakan, “metode buram untuk mewakili apa yang menurut model AI harus ditampilkan,” menurut laporan baru dari Berita NBC Selasa. Dan itu adalah sedikit kejelasan yang menyegarkan tentang apa yang terjadi dengan alat AI ini di dunia yang penuh dengan AI.

“Pengadilan ini berkesimpulan bahwa pengakuan atas bukti-bukti yang disempurnakan ini akan menyebabkan kebingungan dalam permasalahan dan kebingungan dalam kesaksian para saksi mata, dan dapat mengakibatkan persidangan yang memakan waktu dalam persidangan mengenai proses non-peer-reviewable yang digunakan oleh model AI,” tulis McCullough.

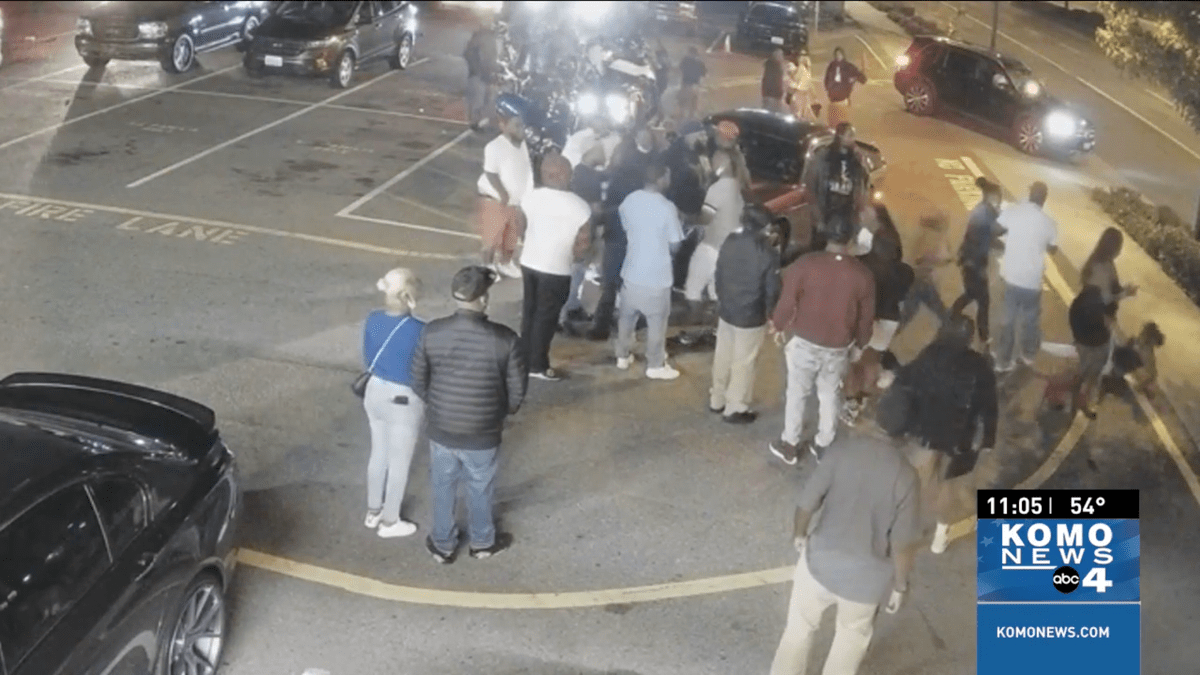

Kasus ini melibatkan Joshua Puloka, seorang pria berusia 46 tahun yang dituduh membunuh tiga orang dan melukai dua lainnya di sebuah bar di luar Seattle. pada tahun 2021. Pengacara Puloka ingin memperkenalkan video ponsel yang diambil oleh seorang pengamat yang telah disempurnakan dengan AI, meskipun tidak jelas apa yang mereka yakini dapat diperoleh dari rekaman yang diubah tersebut.

Pengacara Puloka dilaporkan menggunakan seorang “ahli” dalam produksi video kreatif yang belum pernah menangani kasus pidana sebelumnya untuk “menyempurnakan” video tersebut. Alat AI yang digunakan pakar yang tidak disebutkan namanya ini dikembangkan oleh yang berbasis di Texas Topaz bibiryang tersedia bagi siapa saja yang memiliki koneksi internet.

Pengenalan alat pencitraan bertenaga AI dalam beberapa tahun terakhir telah menyebabkan kesalahpahaman luas tentang apa yang bisa dilakukan dengan teknologi ini. Banyak orang percaya bahwa menjalankan foto atau video melalui peningkatan AI dapat memberi Anda gambaran lebih baik tentang informasi visual yang sudah ada. Namun pada kenyataannya, perangkat lunak AI tidak memberikan gambaran yang lebih jelas tentang informasi yang ada dalam gambar—perangkat lunaknya saja menambahkan informasi yang sebenarnya tidak ada di sana.

Misalnya, ada teori konspirasi yang tersebar luas bahwa Chris Rock mengenakan semacam penutup wajah ketika dia ditampar oleh Will Smith di Academy Awards pada tahun 2022. Teori ini dimulai karena orang-orang mulai mengambil tangkapan layar dari tamparan tersebut melalui peningkatan gambar, dengan keyakinan bahwa mereka bisa melihat lebih baik apa yang sedang terjadi.

Namun hal tersebut tidak terjadi jika Anda menjalankan gambar melalui peningkatan AI. Program komputer hanya menambahkan lebih banyak informasi dalam upaya membuat gambar lebih tajam, yang sering kali dapat merusak apa yang sebenarnya ada. Dengan menggunakan penggeser di bawah, Anda dapat melihat gambar piksel yang menjadi viral sebelum orang-orang mulai memasukkannya melalui program AI dan “menemukan” hal-hal yang tidak ada dalam siaran aslinya.

Foto dan video beresolusi tinggi yang tak terhitung jumlahnya dari kejadian tersebut menunjukkan secara meyakinkan bahwa Rock tidak memiliki bantalan di wajahnya. Namun hal ini tidak menghentikan orang untuk percaya bahwa mereka dapat melihat sesuatu yang tersembunyi secara kasat mata dengan “meningkatkan” gambar ke “8K.”

Munculnya produk-produk berlabel AI telah menciptakan banyak kebingungan di kalangan kebanyakan orang tentang apa yang sebenarnya dapat dicapai oleh alat-alat ini. Model bahasa besar seperti Obrolan GPT telah meyakinkan orang-orang cerdas bahwa chatbots ini mampu melakukan penalaran yang rumit padahal sebenarnya bukan itu yang terjadi. LLM pada dasarnya hanya memprediksi kata berikutnya yang harus dilontarkannya agar terdengar seperti manusia yang masuk akal. Namun karena mereka mampu terdengar seperti manusia dengan cukup baik, banyak pengguna yang percaya bahwa mereka melakukan sesuatu yang lebih canggih daripada trik sulap.

Dan sepertinya itulah kenyataan yang akan kita jalani selama ini miliaran dolar dikucurkan ke perusahaan AI. Banyak orang yang seharusnya mengetahui lebih baik percaya bahwa ada sesuatu yang besar sedang terjadi di balik layar dan dengan cepat menyalahkan “bias” dan batasan yang terlalu ketat. Namun ketika Anda menggali lebih dalam, Anda akan menemukan ini yang disebut halusinasi bukankah suatu kekuatan misterius dilakukan oleh orang-orang yang terlalu sadar, atau apalah. Mereka hanyalah produk dari teknologi AI yang tidak berfungsi dengan baik.

Untungnya, seorang hakim di Washington menyadari bahwa teknologi ini tidak mampu memberikan gambaran yang lebih baik. Meskipun kami yakin ada banyak hakim di AS yang percaya pada hype AI dan tidak memahami implikasinya. Hanya masalah waktu sebelum kita mendapatkan video yang disempurnakan dengan AI yang digunakan di pengadilan yang tidak menampilkan apa pun kecuali informasi visual yang ditambahkan setelah kejadian tersebut.